Les algorithmes actuels d’intelligence artificielle sont extrêmement exigeants en matière de mémoire vive : les transferts de données entre le processeur et la mémoire du système sont critiques pour ce type d’applications, et les performances de ces algorithmes dépendent fortement de la bande passante disponible. Face à ce constat, NVIDIA développe actuellement – en partenariat avec de grands noms du secteur tels que Samsung, SK Hynix et Micron – une nouvelle norme de mémoire conçue spécifiquement pour répondre à ces besoins. Baptisée SOCAMM (System on Chip Advanced Memory Module), cette nouvelle architecture de mémoire vive devrait être utilisée dans la prochaine génération de supercalculateurs dits “personnels”. C’est en tout cas la vision de NVIDIA pour ce marché.

De la mémoire dédiée aux calculs d’IA

L’une des caractéristiques clés de la mémoire SOCAMM est sa large interface d’entrées/sorties. La SOCAMM fonctionne avec 694 ports d’I/O là où la mémoire DDR5 classique des ordinateurs se limite à 260 lignes. Cette augmentation permet d’atténuer les goulots d’étranglement dans le transfert de données entre le processeur et la mémoire, accélérant ainsi considérablement les calculs d’IA. Plus dense que la DRAM habituelle, cette mémoire offre également une réduction de la consommation d’énergie en se basant sur la technologie LPDDR5X. La mémoire SOCAMM adopte par ailleurs une architecture modulaire, permettant aux utilisateurs de remplacer et de mettre à niveau facilement les modules de mémoire en cas de besoin.

A lire aussi : Empilement à gogo et silicium photonique : la recette de NVIDIA pour les futures puces IA

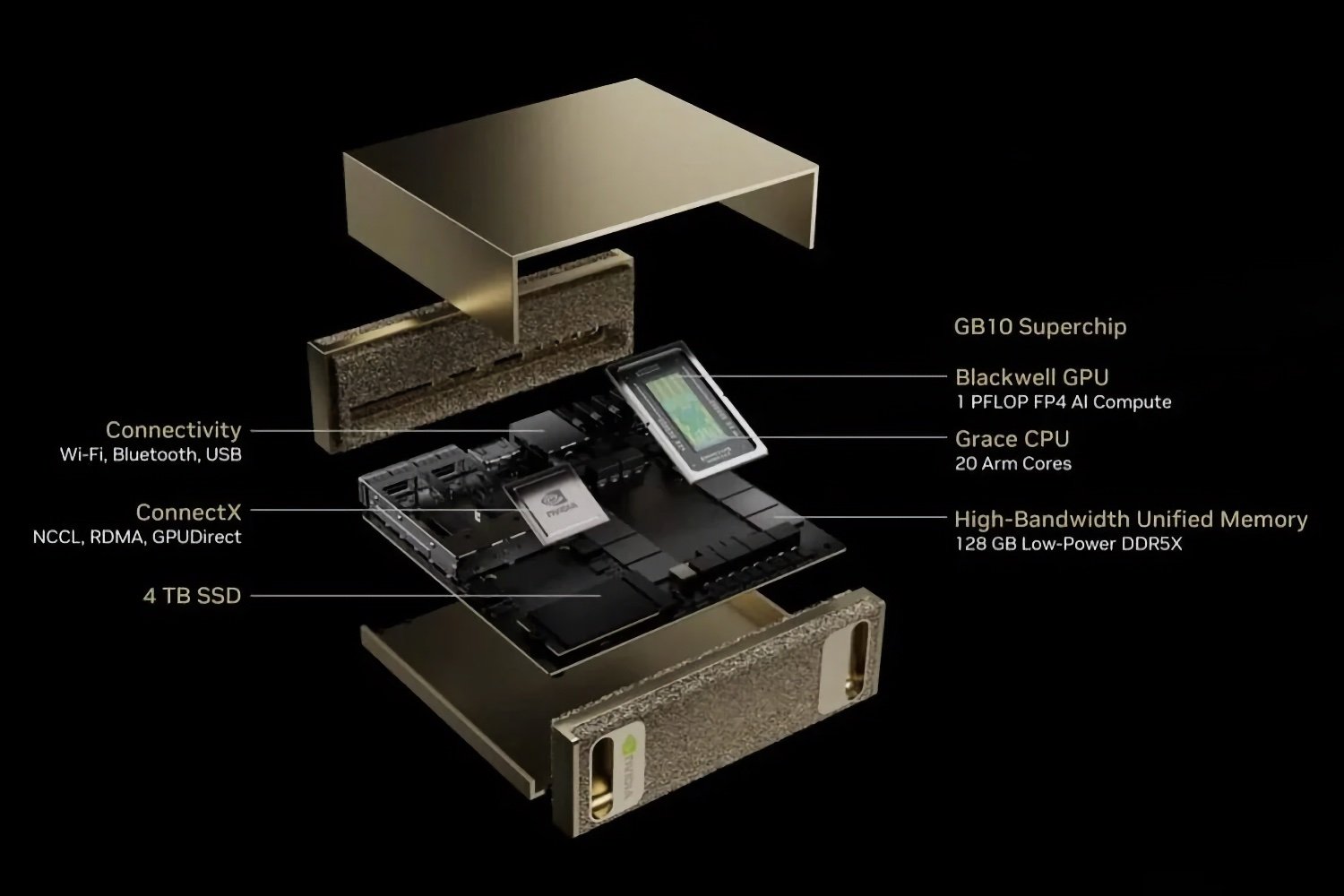

NVIDIA prévoit d’intégrer ce type de mémoire dans ses futurs systèmes d’IA compacts personnels, notamment dans le cadre de son projet DIGITS dont les premiers produits finaux devraient apparaitre sur le marché en mai prochain. Celui-ci vise à mettre au point de véritables mini supercalculateurs d’IA, pour les développeurs et les entreprises dans un premier temps avant de probablement les proposer par la suite au grand public. En développant dès à présent sa propre norme de mémoire dédiée à l’intelligence artificielle, NVIDIA espère sans doute prendre le contrôle de cet écosystème naissant ; l’approche du constructeur pourrait ainsi lui conférer un avantage concurrentiel significatif à long terme.

🔴 Pour ne manquer aucune actualité de 01net, suivez-nous sur Google Actualités et WhatsApp.

Source : Tom's Hardware