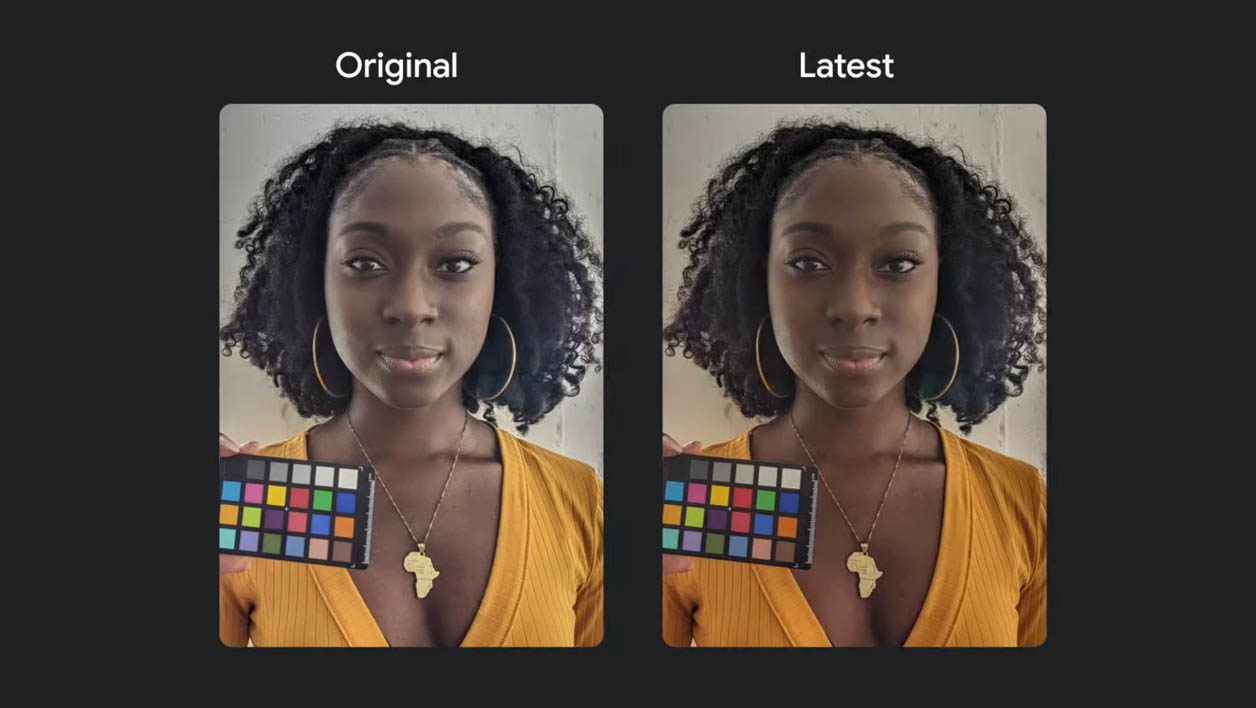

Google travaille sur de nouveaux algorithmes visant à améliorer la justesse du rendu des peaux noires dans les photos prises avec des smartphones. Il s’agit là d’un vieux problème de la science des couleurs.

Depuis l’ère argentique, la plupart des procédés sont optimisés pour les peaux à teinte claire des peuples européens et asiatiques. Ce biais a perduré dans le monde numérique avec des mécanismes, comme la balance des blancs, qui sous-exposent les peaux noires et rendent très mal la richesse des tons marrons/noirs.

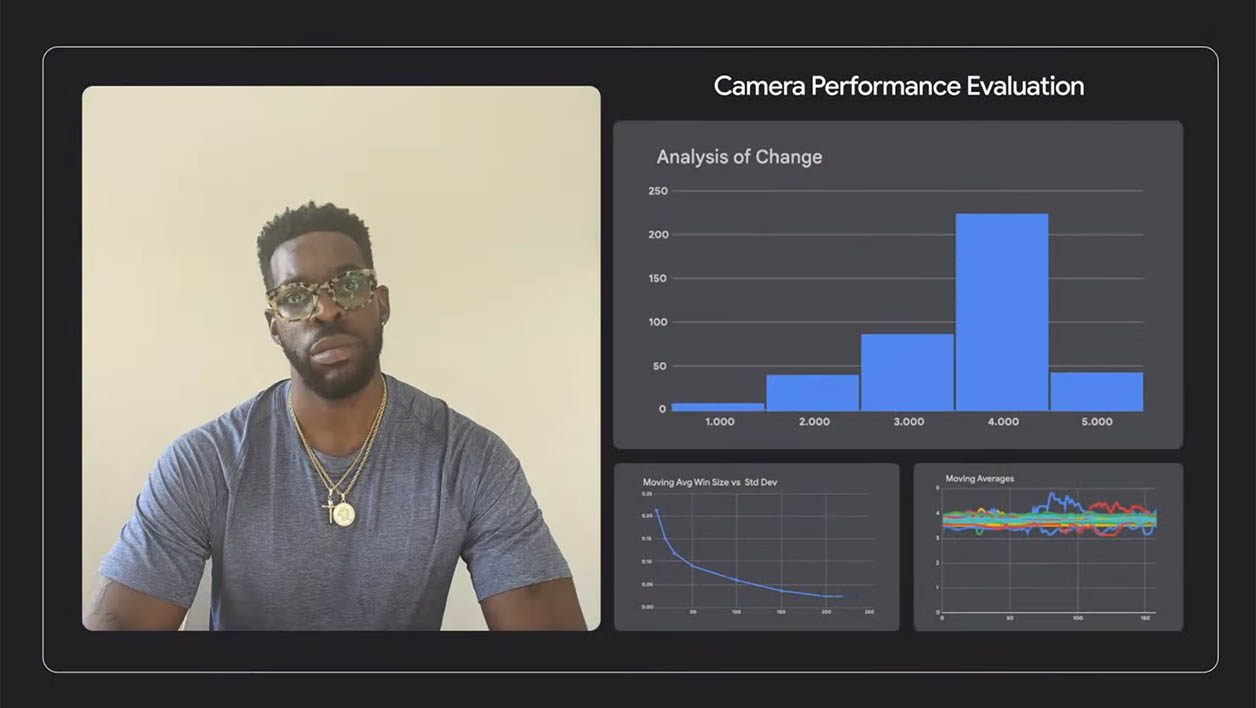

Les ingénieurs de Google ont donc décidé de s’attaquer au problème. Ils développent de nouveaux algorithmes, entraînent les IA en partant de zéro spécifiquement pour les peaux noires. Un nouveau panel d’outils numériques qui, couplés aux algorithmes existants, devraient permettre aux futurs smartphones Pixels de rendre correctement toutes les carnations humaines.

Au défi culturel, qui vise à donner autant d’attention à la « color science » des peaux noires, s’ajoute un vrai défi technique : mieux respecter la complexité des chevelures crépues, notamment dans les algorithmes de génération computationnelle des flous d’arrière-plan.

Un défi d’importance car même les cheveux longs et lisses, ou les simples mèches rebelles posent des problèmes en matière de calcul. Dès lors, l’intrication et la complexité des cheveux crépus pose un problème d’une toute autre magnitude.

À découvrir aussi en vidéo :

Google pourrait déployer la mise à jour de ses outils numériques photographiques lors du lancement officiel d’Android 12 à l’automne prochain. Il reste à voir si les futurs algorithmes de gestion des chevelures pourront être exécutés par les anciens terminaux.

🔴 Pour ne manquer aucune actualité de 01net, suivez-nous sur Google Actualités et WhatsApp.