Toutes les avancées technologiques ne sont pas bonnes à prendre et celle du « Deepfake », cette technique de falsification audiovisuelle fondée sur des réseaux neuronaux, est particulièrement toxique. Elle permet de changer les têtes des actrices de films pornos, de modifier les discours de politiciens ou de célébrités, voire de créer des arnaques. Bienvenue dans un monde de mensonges et de faux-semblants.

Il n’est donc pas étonnant que Facebook, qui est déjà confronté à des hordes de trolls et à des vagues d’intox, soit très intéressé par le blocage de ce type de contenus. Le réseau social a profité de la conférence NeurIPS, qui s’est déroulée du 8 au 15 décembre à Vancouver, pour lancer officiellement son « Deepfake Detection Challenge ».

10 millions de dollars de récompense

L’idée est de mettre à disposition des chercheurs en intelligence artificielle un corpus de plus de 100 000 vidéos « Deepfake » et de les inciter à développer des techniques de détection. Google a créé un corpus similaire, mais il est beaucoup moins large. Par ailleurs, Facebook va beaucoup plus loin en mettant 10 millions de dollars de bourses et de récompenses sur la table pour les meilleures équipes… à condition qu’elles publient leurs codes en open source.

*Plus de 150 équipes se sont inscrites. Elles ont jusqu’en mars 2020 pour déposer leurs solutions qui seront évaluées au travers d’un set de données non publiées. « C’est un enjeu énorme pour Facebook, explique Antoine Bordes, co-directeur de Facebook AI Research, à l’occasion d’une conférence de presse à Paris. Nous développons déjà des méthodes de détection en interne, mais nous ne pouvons pas tout faire tout seuls. C’est pourquoi nous essayons de fédérer la communauté de façon ouverte autour de cette problématique. »

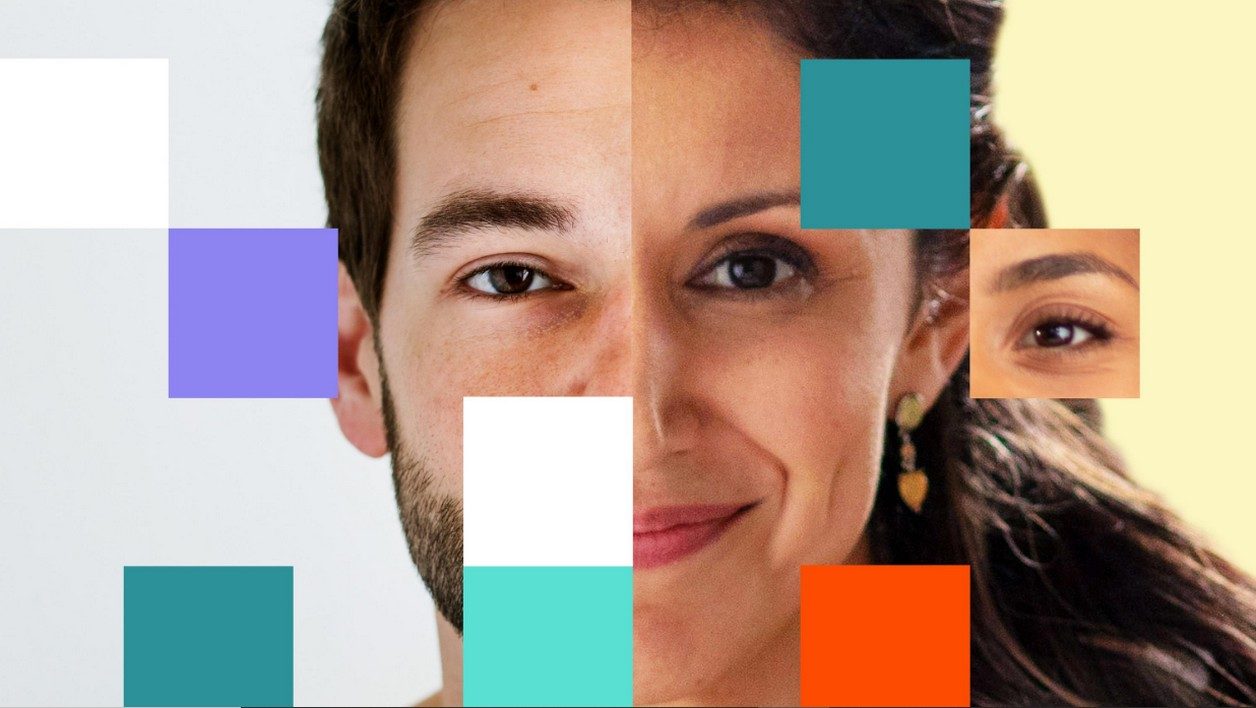

Pour créer cet ensemble de données, Facebook a engagé des acteurs et les a filmés dans des situations diverses et variées. Puis l’entreprise a généré des Deepfake de ces enregistrements en utilisant les meilleures techniques disponibles. Dans l’exemple ci-dessus, fourni par Facebook, saurez-vous déterminer quelle est la vidéo originale ? (Petite astuce : bien regarder les yeux et leurs contours*).

Le Deepfake, comment ça marche?

La création de Deepfake s’appuie sur deux types de réseaux neuronaux mis en cascade : les « auto-encodeurs » et les « réseaux adverses génératifs » (ou GAN, generative adversarial network). Les auto-encodeurs sont des algorithmes composés d’un « encodeur » et d’un « décodeur ». Le premier est capable de réduire une image à une représentation mathématique minimaliste appelée « latent ». Le second est capable de reconstituer l’image à partir de cette représentation. Pour remplacer la tête de Clara Morgane par celle de Scarlett Johansson, il suffit ensuite de combiner l’encodeur de la première avec le décodeur de la seconde. Et le tour est joué.

Les auto-encodeurs peuvent également être de type variationnel. Au lieu de simplement recréer des images bien connues, ils peuvent alors en générer d’autres qui sont similaires, en faisant varier les caractéristiques selon une courbe de probabilité.

Mais le processus d’encodage-décodage présente un désavantage : des informations sont perdues en cours de route. Dans le cas d’une génération variationnelle, des zones de flou peuvent également apparaître. Des chercheurs ont donc eu l’idée de combiner les auto-encodeurs avec des GAN, qui ont pour mission de ne laisser passer que les images de qualité suffisante.

En effet, un réseau adverse génératif est composé de deux réseaux neuronaux qui sont en compétition. Le premier génère des images alors que le second doit déterminer si ces images sont vraies ou fausses, au regard de l’entraînement qu’il a subi. Plus ce discriminateur est pointu dans son analyse, plus l’image générée qui en sortira apparaîtra comme « vraie ». Dans le cas d’un générateur de Deepfake, le décodeur de l’auto-encodeur est tout simplement remplacé par le générateur du GAN.

Pour détecter les Deepfake, les chercheurs vont, là encore, s’appuyer sur des réseaux de neurones profonds qu’ils vont configurer et entraîner de telle manière à pouvoir reconnaître le vrai du faux. D’où l’intérêt d’avoir de larges sets de données comme celui fourni par Facebook. La détection de Deepfake est un domaine naissant, même s’il existe déjà plus d’une dizaine d’approches différentes. Certains chercheurs se concentrent sur le clignement des yeux, d’autres sur des incohérences temporelles entre les images, d’autres encore sur leur texture et leur résolution.

Vers une course sans fin?

Ces recherches vont évidemment provoquer une course à l’échalote. À mesure que les détecteurs se perfectionneront, les générateurs vont gagner en qualité. Cette course à la détection, est-il possible de la gagner ? Facebook y croît. « Regardez ce qui s’est passé avec les spams. Les filtres fonctionnent et le problème a été résolu. Dans le domaine des Deepfakes, ce sera pareil. Plus la technologie de détection s’affinera, plus le coût d’une falsification indétectable deviendra prohibitif. Le jour où il faudra louer une grappe de calcul pendant plusieurs jours pour créer une bonne vidéo Deepfake, les gens vont arrêter d’en faire », estime Antoine Bordes.

En d’autres termes, dans la course au Deepfake, le gagnant sera finalement celui qui aura la plus grosse puissance de calcul. Et il sera difficile de battre Facebook sur ce terrain.

* La vidéo originale est celle située en haut à gauche.

🔴 Pour ne manquer aucune actualité de 01net, suivez-nous sur Google Actualités et WhatsApp.