Le pape en doudoune gangsta-chic au Vatican ou Emmanuel Macron avec sa baguette aux barricades dans une manifestation contre ses propres décisions : vous avez peut-être vu ces fausses photos passer sur les réseaux sociaux, en avez lu des articles qui s’en amusent ou qui s’en inquiètent. Ces derniers sont sans aucun doute les plus prescients. Si les « clichés » des IA, que l’on pourrait appeler des « synthégraphies » (photographies synthétiques, rien à voir avec l’acte médical de la scintigraphie !), restent à l’heure actuelle encore imparfaits, la qualité actuelle atteint déjà un niveau alarmant. Et ce n’est que le début.

Car le robinet de la production de contenus crédibles créé par les IA à la Midjourney ou Stable Diffusion ne va plus jamais pouvoir être refermé. Les philosophes, sociologues et autres spécialistes des comportements étudient déjà le phénomène, les législateurs pourraient rapidement s’emparer du sujet pour (tenter de !) les encadrer. Pour vous et moi, la fulgurance des IA dans la création d’images photoréalistes impose surtout de prendre immédiatement une posture de recul face à toute photo partagée ou publiée. Car nous subissons le revers de ce succès technologique : la perte de confiance dans les images et le risque de leur instrumentalisation. Plus particulièrement de la part de pays qui déploient depuis plusieurs années de véritables stratégies de désinformation de masse, comme la Russie.

Sans tomber dans le mélodramatique, il est urgent que tous les pans de l’industrie de la chaîne de l’image réagissent et mettent sur pied des solutions pour permettre de croire à nouveau dans les images que nous voyons. Un combat perdu d’avance ? Pas forcément. Car il existe déjà un cadre technique destiné aux photos de presse. Les premiers pas ont été timides, sporadiques et non coordonnés. La menace de Midjourney et autres pourrait être l’étincelle nécessaire à la reconstruction de la confiance dans les images de presse. Et la solution pourrait venir d’un projet antérieur à l’avènement des modèles IA, et qui semble tout indiqué pour nous protéger : la CAI.

La traque des retouches et falsifications

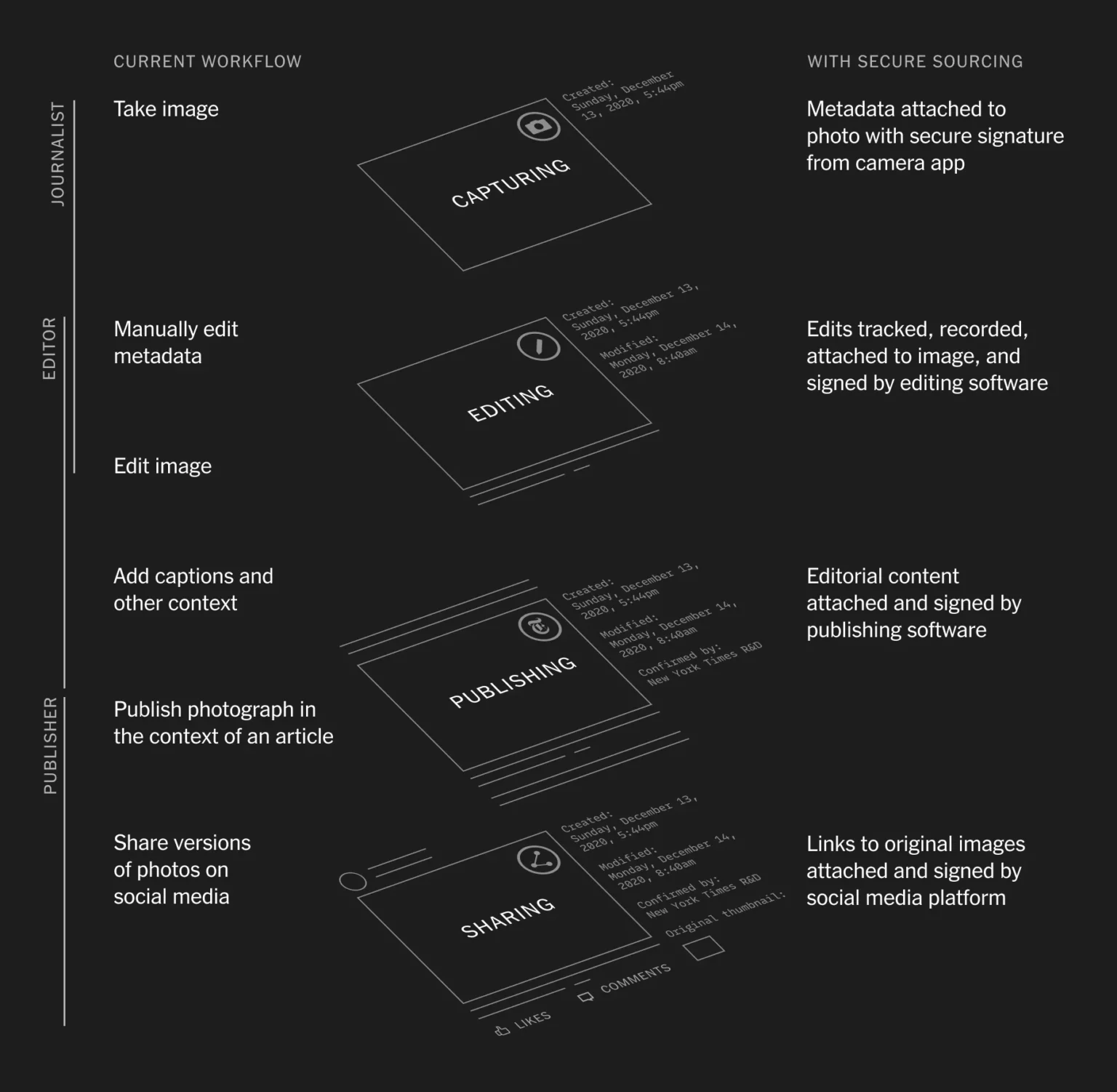

La Content Authenticity Initiative ou CAI (Initiative d’authentification du contenu) a été en partie développée par Adobe et le New York Times. Le projet ne ciblait pas les IA, mais simplement les clichés numériques. Le terme de CAI regroupe un framework et des outils logiciels conçus pour garantir la véracité d’une image. Le principe implique en premier lieu que l’appareil photo soit capable de déposer une signature numérique unique au moment de l’enregistrement. Ensuite, cette signature est complétée par des informations des modifications de l’image : recadrage, modification de la balance des blancs, petit coup de netteté sur une image un peu flou, etc. Ainsi, l’éditeur photo, journaliste ou simple citoyen est à même de contrôler le parcours, ainsi que les altérations de la photographie.

Comme vous vous en doutez, il s’agit d’une chaîne de protection de l’image qui se doit d’être complète. Elle commence à l’intérieur des appareils de prise de vue, elle se poursuit dans les logiciels d’édition et de distributions de photos (ainsi que dans une éventuelle base de données de contre-vérification des images). Mais elle doit aussi arriver jusqu’aux lecteurs, par le biais de modules de visionnage intégrés aux sites qui doivent leur permettre de rapidement pouvoir être rassurés. Tout cela, ceux qui sont responsables de l’établissement du cadre technique du standard, comme les ingénieurs d’Adobe, le savent bien. À la manière du Bluetooth, du HDMI et autres protocoles, la CAI développe des outils. Mais c’est à la charge des différents industriels que de l’implémenter. Et c’est là que ça coince un peu.

Une industrie en désordre de bataille

Le premier industriel de l’image à annoncer du matériel compatible avec la CAI n’est pas celui que vous croyez. Si vous imaginez un acteur japonais de la photo, vous avez bien perdu, puisqu’il s’agit de l’Américain Qualcomm, le champion des puces pour smartphones. Car les smartphones se vendent dans de bien plus gros volumes que les boîtiers photos, faisant de Qualcomm, numéro 1 mondial des puces mobiles, la première « marque photo » du monde. Logique, ce sont ses technologies (notamment son processeur d’image Spectra) qui ont la charge de faire la majorité des photos de la planète. Viennent ensuite MediaTek et Apple, les marques photo (Sony, Nikon, Fujifilm, etc.) n’arrivant plus que loin derrière en termes de volumes.

À lire aussi : Snapdragon 888 : pourquoi son processeur d’image Spectra 580 est une révolution (décembre 2020)

C’est en décembre 2020, lors de l’annonce de son fleuron, le Snapdragon 888, que Qualcomm a annoncé être partenaire de l’initiative, et concevoir ainsi la première puce prenant matériellement en charge la CAI. Seulement voilà, Qualcomm ne peut pas tout : il est à la charge des constructeurs de smartphones et autres concepteurs logiciels de s’emparer de la technologie. Ce qu’ils n’ont, à notre connaissance, pas fait à l’heure actuelle.

Ce sont ensuite Sony, puis Leica et Nikon qui ont, aux côtés d’Adobe, rejoints la CAI. Chacun annonçant une (unique !) mise à jour d’un de leurs boîtiers phares – respectivement les Alpha A7 IV, M11 et Z9. Des annonces qui ont eu le mérite de montrer que, dans certains cas, il semble qu’une simple mise à jour du logiciel interne permette d’intégrer cette technologie. Il serait de bon ton que les marques photo prennent leur responsabilité – et montre que les boîtiers ont toujours une grande valeur ! – en remontant un peu plus loin dans le temps pour « patcher » le plus de boîtiers possibles. Mais outre le fait que le nombre de boîtiers compatibles est bien maigre – et l’absence de Canon et Fujifilm, deux marques chères aux reporters, est un sacré facteur limitant – la réalité est que la partie matérielle seule ne suffira pas. Il faut concevoir des logiciels qui, sur le papier, ressemble à des applis « métiers », mais dans un champ (la photo de presse), où il n’y a que très peu d’argent.

La responsabilité des organes de presse… et des pouvoirs publics

Les manipulations des « vraies » photo ne datent pas du numérique, elles sont apparues pendant le développement de la photo argentique – Staline n’a pas attendu Photoshop pour faire disparaître Trotski des images officielles ! Le sujet initial de la CAI était d’importance, puisqu’il s’agissait de lutter contre les manipulations de clichés et faciliter leur authentification. Si le circuit des photos de presse, notamment d’agences, est plutôt robuste en matière de vérification de la production, il y a toujours des petits pros de la retouche pour semer le doute.

Face aux rares photographes qui rajoutent parfois un peu de fumée pour dramatiser une image ou effacent un objet pour épurer une composition (des actions qui sont souvent punies par les agences par un licenciement ou une fin de collaboration), la menace des IA est bien plus importante. Car on parle ici d’un potentiel de production de milliards de fausses images, plus vraies que nature. Si les industriels suivent, la CAI pourrait rapidement faire le ménage. Le contrôle des données EXIF (les informations techniques de la prise de vue) couplées à celles apportées par la CAI serait un bon bouclier pour se prémunir des synthégraphies. Le hic ? Les enjeux économiques directs sont inversement proportionnels à la menace.

À lire aussi : Comment Google et des chercheurs veulent nous « vacciner » contre la désinformation (août 2022)

La désinformation peut avoir un impact majeur – regardez le Brexit ! – mais l’économie de la presse est anémique. Entre l’imposition de l’inclusion de la CAI au sein des réseaux sociaux tels que Twitter et Facebook (ces deux acteurs ont continuellement besoin d’une forte motivation juridique pour faire ce qu’on attend d’eux…) et l’inclusion de modules logiciels permettant au grand public de pouvoir contrôler les images affichées dans les différents médias, l’implication des États dans le sujet doit être fort. Le meilleur scénario serait évidemment une initiative européenne. Mais en attendant, un scénario français possible serait de rediriger les aides à la presse en France, qui sont très décriées pour leur opacité, dont les sommes sont versées à un panel limité de rédactions. Développer un cadre légal ainsi que des outils logiciels ouverts pour l’ensemble des acteurs médias seraient de l’argent directement investi dans le soutien non seulement de la presse, mais surtout de la (re)construction de la confiance du grand public envers le quatrième pouvoir.

🔴 Pour ne manquer aucune actualité de 01net, suivez-nous sur Google Actualités et WhatsApp.

“pays qui déploient depuis plusieurs années de véritables stratégies de désinformation de masse, comme la Russie.”

Vous plaisantez!

Ouvrez vos yeux, sortez des clichés, informez-vous!, la désinformation est bien plus manipulée par les USA!

Titre racoleur. L’IA n’a rien a voir… Cela fait des annees que des images retouchees circulent. Il y a des professionnels de la retouche d’image. Ceci dit, avoir un dispositif de certification d’image non truquee ne peut pas faire de mal.