La fonction de retouche magique de Google carburait déjà à l’intelligence artificielle, mais les Pixel 9 ajoutent une nouvelle dimension : il est maintenant possible d’insérer des objets et de réaliser des modifications sur une photo avec l’aide d’une simple instruction texte, grâce à Gemini. Voici un exemple réalisé par nos soins, où il est assez facile de trouver la photo bidouillée avec l’IA de Google :

La manipulation est très rapide, avec des résultats troublants de réalisme. Probablement trop, au vu des exemples qui ont afflué suite à la publication des tests des smartphones aux États-Unis ! Chris Welch de The Verge a posté plusieurs exemples saisissants, comme l’intégration d’un accident vélo contre voiture dans une photo de rue :

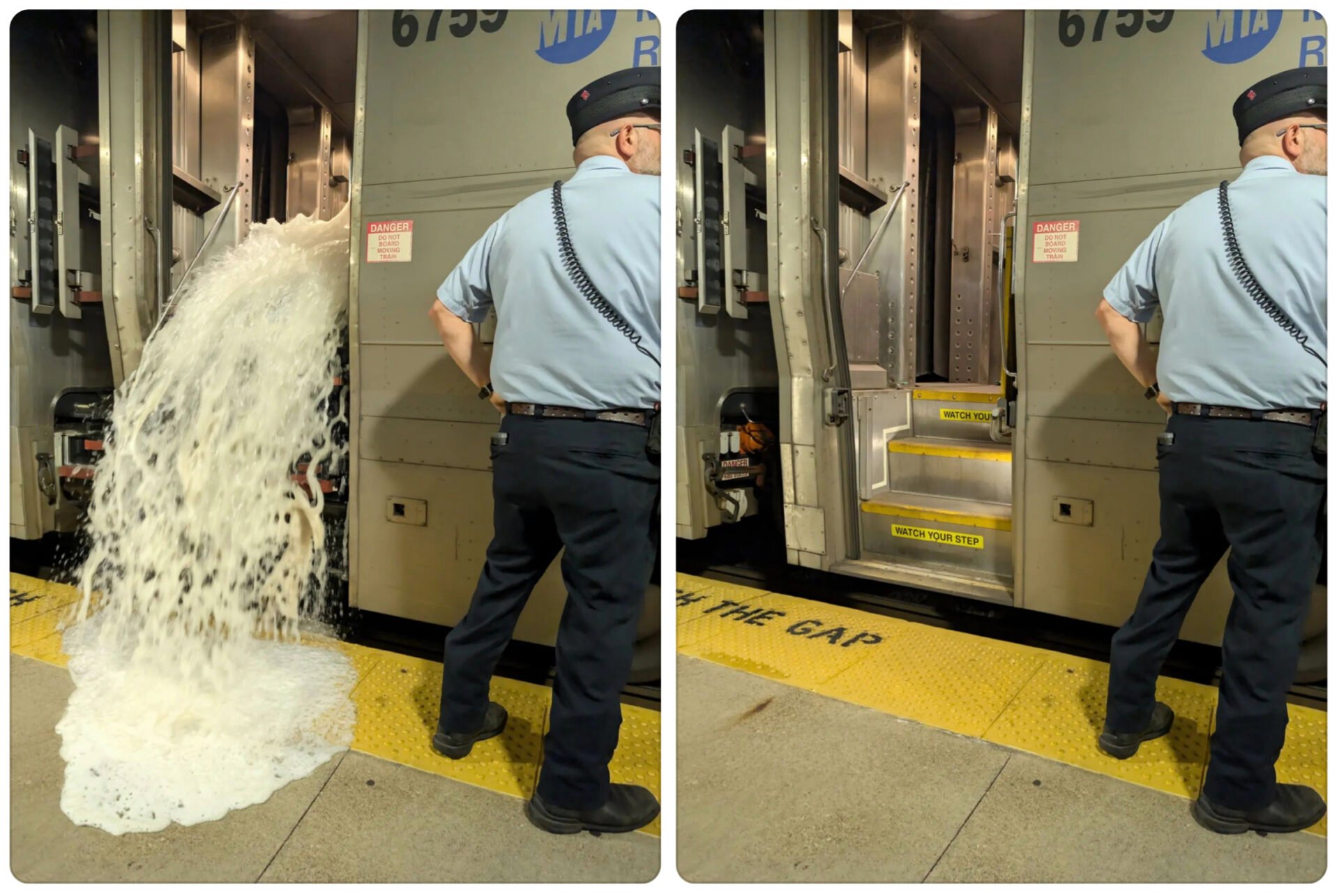

Le Pixel 9 peut également fabriquer de manière convaincante l’inondation d’une rame de métro :

Plus grave, il est aussi très simple de faire croire qu’une personne prise en photo consomme de la drogue :

Google n’a pas cru bon d’insérer un filigrane ou d’intégrer un avertissement indiquant très clairement l’image modifiée ; il faut se contenter d’une mention dans les métadonnées, qu’il est d’ailleurs très facile de supprimer : il suffit de faire une capture d’écran de la photo trafiquée… L’absence d’une alerte est d’autant plus étonnante que Google a mis au point un filigrane SynthID pour repérer les images générées par IA. On imagine assez aisément les dérives possibles.

Faire passer des vessies pour des lanternes grâce à l’IA générative n’a pas été inventé par les Pixel 9, il n’est pas très compliqué de reproduire ces exemples avec des outils existants. Le problème ici réside dans la facilité et la rapidité avec lesquelles il est possible de trafiquer des photos : une simple requête à même l’app appareil photo du smartphone.

En dehors de cet outil d’édition de photo, les Pixel 9 embarquent un outil de création d’images « façon Dall-E », baptisé Pixel Studio. Là aussi c’est très simple, il suffit de décrire l’image que l’on souhaite et Gemini se charge de générer le visuel. Cette application, qui n’est pas disponible en France, n’a aucun problème à créer une image de Bob l’Éponge dans un uniforme nazi, ou d’Elmo conduisant une voiture une bière à la main, comme l’a fait DigitalTrends.

En début d’année, Google avait été obligé de suspendre une précédente version de son outil de génération d’images Gemini, qui créait des images historiques complètement fausses.

Lire Gemini, l’IA générative de Google qui réécrit l’histoire, est mis en pause

Google a réagi à la polémique naissante en déclarant que la retouche magique et Pixel Studio étaient conçus pour « respecter l’intention des requêtes des utilisateurs, ce qui signifie qu’ils peuvent créer du contenu potentiellement offensant lorsque l’utilisateur le demande ». Néanmoins, « tout n’est pas permis» et des garde-fous sont en place pour prévenir les abus. C’est le cas lorsqu’on essaie de modifier l’image d’une personne :

Google admet néanmoins que « certaines requêtes peuvent mettre à l’épreuve ces garde-fous ». Le moteur de recherche s’engage à « améliorer et à affiner continuellement les mesures de protection », et l’entreprise est à l’écoute : DigitalTrends n’a pas pu générer de nouvelles images de Bob l’Éponge nazi 24 heures après avoir prévenu Google.

🔴 Pour ne manquer aucune actualité de 01net, suivez-nous sur Google Actualités et WhatsApp.

le problème c’est que, moi le premier, sommes prets a nous laisser berner pour peu que ca aille dans le sens de ce qu’on veut voir…la technique est innocente

C’est très bien : les gens vont enfin cesser de croire qu’une photo prouve quoi que ce soit. Ça n’a jamais été le cas, mais maintenant tout le monde va en être conscient, et les tentatives de manipulations n’auront plus d’effet.