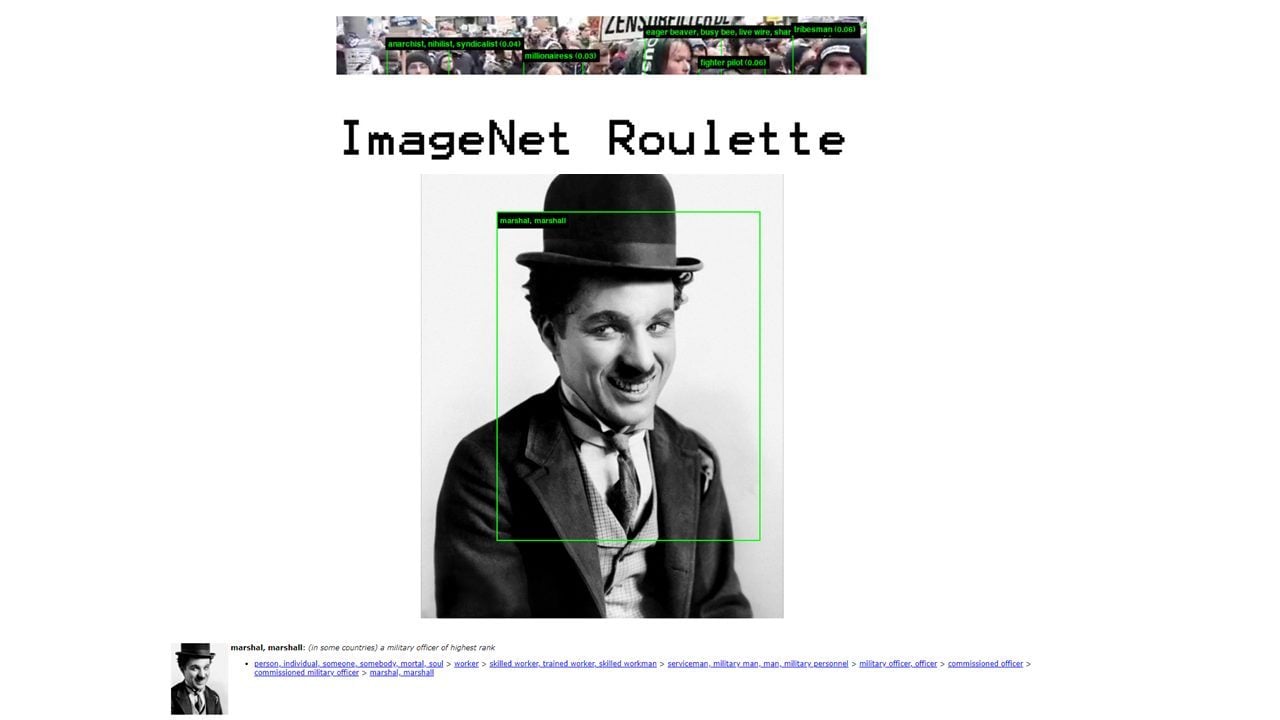

« Nous avons créé ce site comme une provocation ». Ce sont les premiers mots que l’on peut lire sur le site ImageNet Roulette. Cette expérimentation permet de dénoncer les biais discriminants contenus dans les algorithmes de reconnaissance faciale les plus utilisés au monde.

2 500 catégories de « personnes »

D’abord, il faut se prendre en photo -ou télécharger un cliché- de votre visage, puis le site donne son verdict. Puis, on est catégorisé. On peut être classé comme « pilote d’avion », « geek », « non-fumeur » ou « violoncelliste ». Jusque là, pas trop de dénonciation, mais moins drôle le programme classe aussi une femme qui sourit comme « une folle » ou encore un homme comme « suspect de viol ». On comprend mieux l’avertissement en gras : « Attention : ImageNet Roulette donne régulièrement des résultats racistes, misogynes et cruels ».

https://twitter.com/DanAmrich/status/1173694424594833408

Loin de la blague potache, ce projet a pour ambition de critiquer les systèmes de catégorisations arbitraires utilisés par les algorithmes d’intelligence artificielle. ImageNet Roulette utilise les 2 500 catégories de « personnes » de la base de données ImageNet, développée à l’université de Princeton et de Stanford en 2009, l’une des plus utilisées dans le monde pour le machine learning. Pour matcher votre selfie avec une catégorie, ImageNet s’appuie sur la structure sémantique de Wordnet, une base de données lexicale également développée à Pinceton dès les années 80. Or, cette base contient de nombreuses catégories problématiques, notamment racistes et misogynes.

En ligne jusqu’au 27 septembre

ImageNet Roulette s’inscrit dans le cadre de l’exposition artistique sur l’histoire des systèmes de reconnaissance d’image Training Humans qui prend actuellement place au musée Fondazione Prada de Milan. Dans un long article, les activistes ont détaillé le mécanisme discriminatoire d’ImageNet et plus globalement des IA de reconnaissance d’image.

Victoire : devant le succès de cet outil, les responsables d’ImageNet ont annoncé qu’ils allaient supprimer la moitié des images de la catégorie «personnes» et faire un grand ménage dans les catégories problématiques. Ouf. Misssion accomplie pour ImageNet Roulette qui fermera donc ses portes dans quelques jours, le 27 septembre.

🔴 Pour ne manquer aucune actualité de 01net, suivez-nous sur Google Actualités et WhatsApp.