La révolution robotique est en marche, elle accélère même le pas. Tout récemment, il y a d’abord eu Nvidia et Isaac, son simulateur de robot qui permet l’entraînement d’une intelligence artificielle dans un univers virtuel. Et puis, il y a deux jours, OpenAI, le centre de recherches à but non lucratif financé par Elon Musk, a levé le voile sur un de ses derniers progrès en la matière : un robot capable d’apprendre comme un humain, en imitant, en reproduisant des « gestes ».

La réalité virtuelle pour apprendre

Evidemment, pour l’heure, il ne s’agit pas de reproduire à l’identique les mouvements d’un humain. De fait, ce ne sont pas tant les mouvements que le robot apprend à réaliser que la manipulation finale à proprement parler.

Pour faciliter l’apprentissage, les chercheurs ont eu recours à la réalité virtuelle. Un humain, équipé d’un HTC Vive et des manettes qui vont avec, contrôle un bras robotique (différent de celui du robot) dans un environnement virtuel minimaliste. Il y empile méthodiquement une succession de cubes de couleurs. A chaque cube, il déplace le bras virtuel, appuie sur un bouton pour resserrer la pince et attraper le cube, puis le dépose sur un autre cube et relâche la pression.

Cette succession d’actions et de mouvements compose une séance virtuelle qui est soumise au robot. Ou plus exactement à la première des deux intelligences artificielles qui l’animent, un réseau neuronal chargé de la vision. C’est cet algorithme qui va permettre au robot de reconnaître un cube, de savoir comment il se place dans un espace tridimensionnel et de savoir comment interagir avec ces cubes pour réussir à en faire une petite tour.

Il a bien évidemment été préalablement confronté à des dizaines de milliers d’images de cubes virtuels situés dans des environnements virtuels, eux aussi, affichant des couleurs, des textures ou des éclairages différents. Une grande variété environnementales utilisées pendant la phase d’entraînement de l’intelligence artificielle du robot afin qu’elle soit en mesure d’analyser le flux vidéo de la caméra (la réalité) et de s’y « repérer ».

Imiter et prédire…

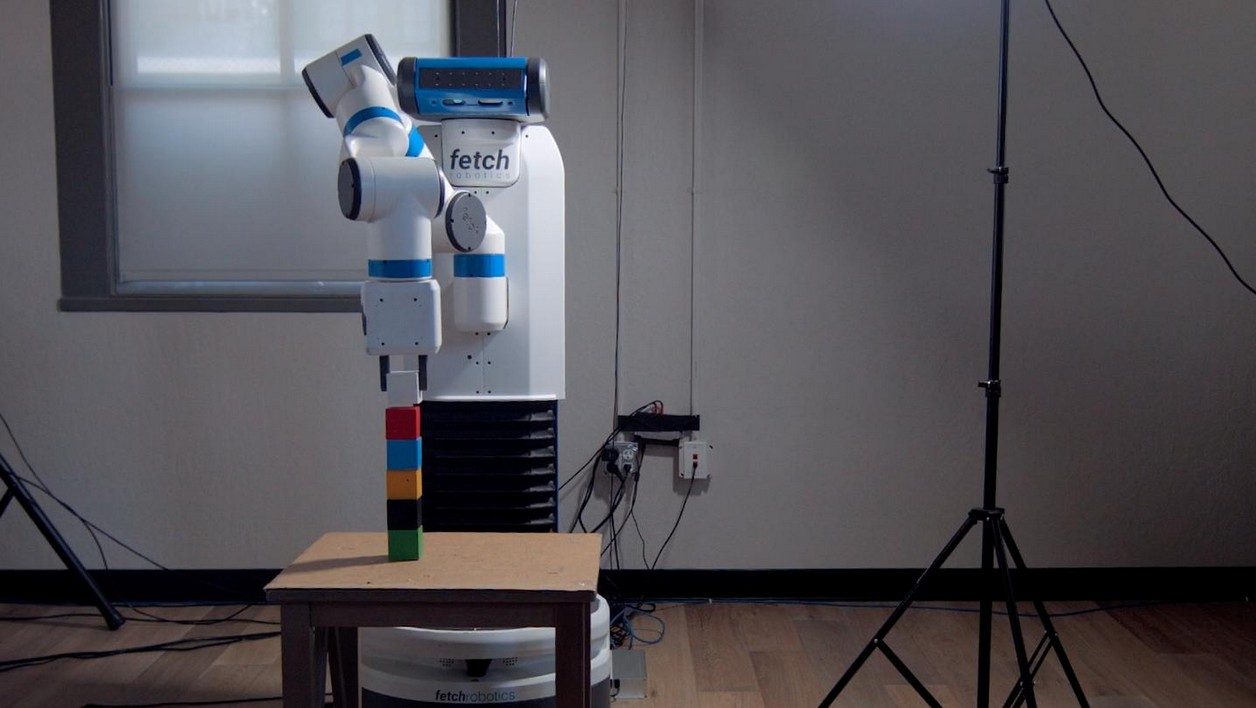

Car, grâce à la caméra dont est équipé le robot, celui-ci reconnaîtra le vrai environnement de « travail » et les vrais cubes placés devant lui. C’est là qu’intervient le deuxième réseau neuronal de ce robot, sobrement appelé Imitation network.

Grâce à cette deuxième couche d’intelligence artificielle, il est capable de savoir quoi faire des vrais cubes quelle que soit leur position de départ, leur arrangement et toujours les empiler dans l’ordre démontré.

Autrement dit, l’IA est capable, même si les cubes ne sont pas placés comme dans la démonstration réalisée par l’humain, de s’adapter en « prédisant » ce qu’aurait fait le bras animé par le démonstrateur. Elle ne répète pas bêtement une succession de mouvements mais a assimilé les différences entre les cubes, la nécessité et l’ordre des mouvements à réaliser, etc.

Epoustouflante ? Cette IA l’est assurément, d’autant que les mouvements qu’elle réalise ne sont pas parfaitement identiques à ceux du bras virtuel qui sert à sa « formation », explique Josh Tobin, un des chercheurs d’OpenAI. Mais ce qui est encore plus incroyable, c’est qu’elle n’a besoin de « voir » cette séquence qu’une seule fois pour être capable ensuite d’imiter ce qu’elle a vu, d’où son nom One shot imitation learning, pour apprentissage par imitation en une seule fois.

Accélérer l’apprentissage et la marche des robots

Ce progrès est d’autant plus important qu’il n’est pas limité à l’empilement de cubes. Il peut être appliqué à toute sorte d’autres cas de figure. En fait, il s’inscrit dans une volonté des chercheurs de réussir à entraîner les intelligences artificielles qui animent les robots à partir de données simulées, virtuelles. Une approche qui fait bel et bien écho à Isaac, de Nvidia, et qui a pour objectif de réduire et le temps et le coût nécessaires aux apprentissages profonds.

Là où Nvidia veut permettre au robot d’apprendre tout seul par itération, OpenAI veut trouver un moyen de transmettre rapidement un « savoir » à des robots qui sauront ensuite s’adapter à un environnement différent. « Les enfants sont nés avec la capacité d’imiter ce que font les autres. […] Nous aimerions que nos robots puissent apprendre de cette manière également », explique Josh Tobin.

Pour l’heure, ces recherches n’en sont évidemment qu’au stade de l’expérimentation. Mais, trouver un moyen de « former » les intelligences artificielles plus vites et mieux pourrait résoudre un des deux freins à la montée en puissance des robots. Ne restera alors plus qu’à réussir à dépasser certaines limites physiques liées à certains facteurs de formes de ces machines intelligentes. Une paille ! C3PO n’est décidément pas pour demain…

🔴 Pour ne manquer aucune actualité de 01net, suivez-nous sur Google Actualités et WhatsApp.