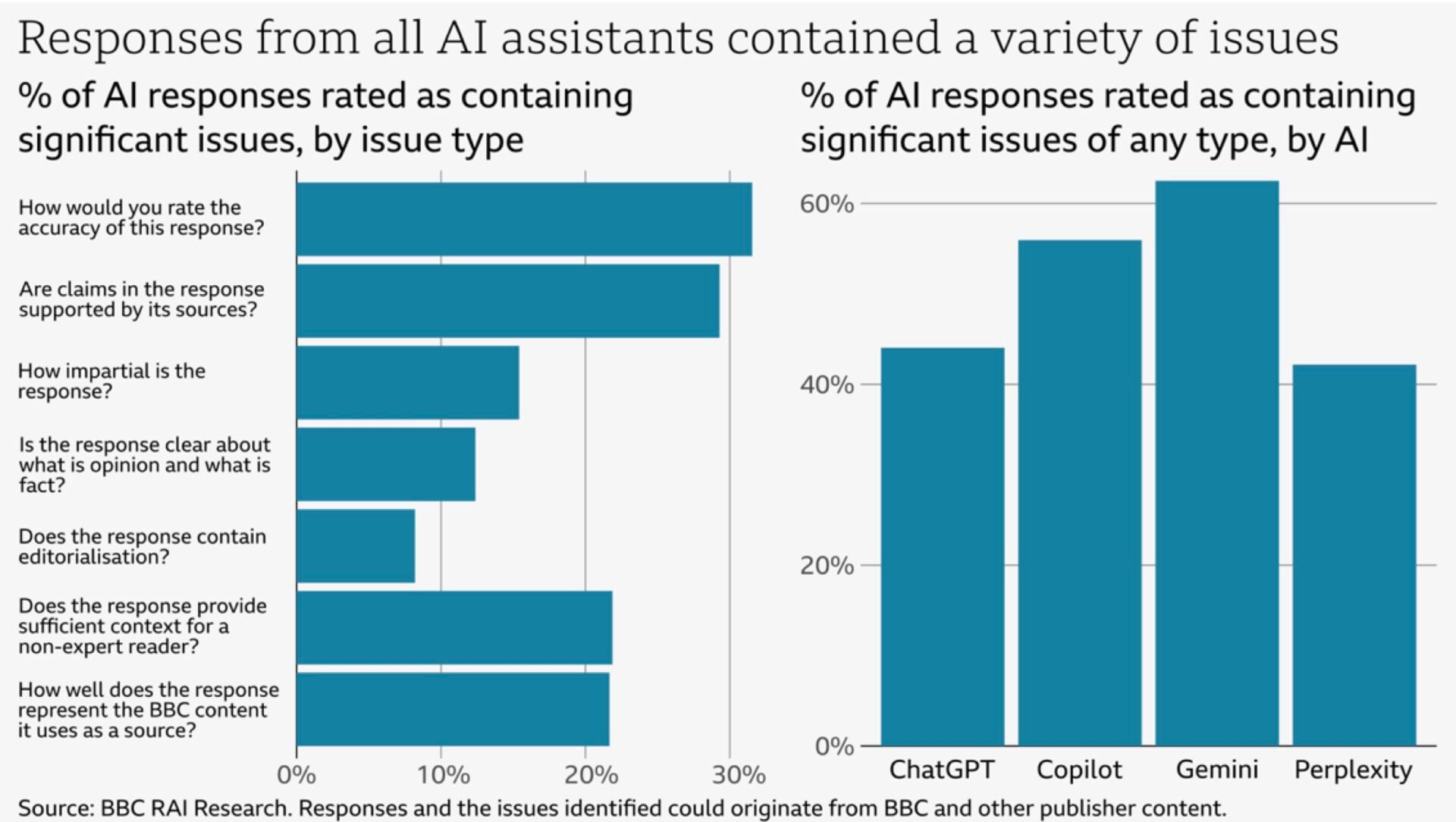

Mieux vaut ne pas prendre pour argent comptant les résumés de l’actualité produits par les chatbots. La BBC a constaté que 51 % des réponses portant sur des requêtes liées à l’actualité et aux nouvelles présentaient des « problèmes significatifs ». 19 % des réponses citant la BBC comme source contiennent des erreurs factuelles (dans les chiffres, les dates, ou les les déclarations).

Quand l’IA réécrit les faits

L’enquête portait sur ChatGPT, Copilot, Gemini et Perplexity, dont les modèles ont pu mouliner les infos publiées par le site de la BBC au mois de décembre (en temps normal, l’entreprise bloque l’accès de son contenu aux bots IA). Les réponses générées par ces IA ont ensuite été passées au crible par des journalistes spécialisées dans les faits d’actualité résumés par les bots. Comme on le voit, les résultats ne sont guère encourageants, même si Perplexity et ChatGPT se sont un peu mieux sortis de l’exercice.

Quelques exemples parmi tant d’autres : Copilot a affirmé que des pertes de mémoire et des trous noirs avaient amené Gisèle Pelicot à découvrir les crimes dont elle avait été victime. Or, ce sont les policiers qui lui ont révélé les viols, en lui montrant des vidéos retrouvées après l’arrestation de son mari. Gemini a expliqué que le NHS, le service de santé britannique, ne recommandait pas la cigarette électronique pour arrêter de fumer (au contraire, le NHS suggère de cette solution intérimaire).

ChatGPT et Copilot ont également assuré que Rishi Sunak, ancien Premier ministre britannique, et Nicola Sturgeon, son homologue en Écosse, étaient toujours aux affaires — c’est faux. Les bots ont des difficultés à « différencier l’opinion du fait, adoptaient un ton éditorial et omettaient souvent des éléments de contexte essentiels », en plus de contenir des inexactitudes factuelles.

« Il n’est pas difficile de voir à quelle vitesse la déformation de la réalité par l’IA pourrait saper une confiance déjà fragile dans les faits et les informations vérifiées », explique Deborah Turness, cheffe de BBC News.

« Nous vivons une époque troublée, et combien de temps faudra-t-il avant qu’un titre altéré par l’IA ne cause des dommages significatifs dans le monde réel ? Les entreprises qui développent des outils d’IA générative jouent avec le feu. » Deborah Turness

La BBC demande aux fournisseurs IA de donner le contrôle aux éditeurs de presse sur l’utilisation de leur contenu et la manière dont il est exploité. Le débat fait rage, et il est loin d’être terminé. Alors qu’Apple Intelligence a été pris en flagrant délit de raconter de grosses bêtises, le constructeur a désactivé temporairement le résumé des notifications pour les apps de presse. Il faudra sûrement aller plus loin pour bâtir un lien de confiance entre l’utilisateur, l’IA, et les éditeurs.

🔴 Pour ne manquer aucune actualité de 01net, suivez-nous sur Google Actualités et WhatsApp.

Source : BBC